In vielen Bildungseinrichtungen kommt es jedes Semester zu einer stillen Krise: Studierende rutschen vom „leichten Rückstand“ in „gefährdet“ ab, ohne dass es jemand merkt. Wenn akademische Misserfolge offiziell in den Noten am Ende des Semesters vermerkt werden, ist der Schaden oft schon angerichtet. In diesem Stadium sind Interventionen nicht nur teurer und schwieriger umzusetzen, sie sind auch weitaus weniger wirksam bei der Umkehr des Abwärtstrends.

Allerdings bietet ein technologischer Wandel einen Weg vom reaktiven Krisenmanagement zur proaktiven Unterstützung. Durch den Einsatz von Explainable AI (XAI) können Schulen jetzt Schüler mit Schwierigkeiten in Echtzeit anhand der bereits generierten Daten identifizieren.

Die Macht der „erklärbaren“ Intelligenz

Traditionell funktionieren viele KI-Systeme als „Black Boxes“ – sie liefern ein Ergebnis oder eine Vorhersage, können aber nicht erklären, warum sie zu dieser Schlussfolgerung gelangt sind. Für einen Lehrer ist eine Benachrichtigung mit der Meldung „Schüler X ist gefährdet“ frustrierend, wenn der Kontext fehlt.

Explainable AI (XAI) verändert diese Dynamik, indem es Transparenz schafft. Anstelle einer einfachen Warnung bietet XAI eine Begründung: Es erklärt, was passiert ist, was derzeit geschieht und was voraussichtlich als nächstes passieren wird. Dadurch können Pädagogen:

– Bestätigen Sie die Erkenntnisse: Bestätigen Sie, ob die KI einen echten Trend oder eine Datenanomalie erkannt hat.

– Annahmen herausfordern: Nutzen Sie die Argumentation der KI, um neue Perspektiven auf das Verhalten eines Schülers zu gewinnen.

– Handeln Sie präzise: Gehen Sie vom Rätselraten zu gezielten Interventionen über.

Aktuelle Forschungsergebnisse unterstreichen die Wirksamkeit dieses Ansatzes und zeigen, dass diese Systeme Kursergebnisse vorhersagen und gefährdete Studierende mit einer Genauigkeitsrate von etwa 93 % identifizieren können.

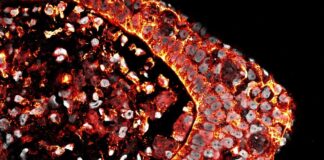

Digitale Fußabdrücke in Frühwarnungen umwandeln

Die für diese Erkenntnisse erforderlichen Daten erfordern keine invasive Überwachung; Ein Großteil davon stammt aus routinemäßigen Interaktionen in virtuellen Lernumgebungen. Pädagogen wissen seit langem, dass Partizipation ein führender Indikator für Erfolg ist. XAI übersetzt digitale „Spuren“ – etwa wie oft ein Student auf Materialien klickt oder wie oft er auf Kursmodule zugreift – in umsetzbare Informationen.

Da diese Signale kontinuierlich sind und nicht an regelmäßige Untersuchungen gebunden sind, liefern sie einen konstanten Datenstrom. Dies ermöglicht ein „GPS-ähnliches“ Leitsystem für Lehrkräfte, das sie zu Schülern führt, die Hilfe benötigen, bevor sie bei einer wichtigen Prüfung durchfallen.

Von den Daten zur Aktion: Der Workflow des Supports

Der wahre Wert der KI im Bildungswesen liegt in ihrer Integration in Schulabläufe. Plattformen wie RADAR zeigen, wie dies in der Praxis funktioniert, indem sie akademische Leistungen, Anwesenheit und „Soft Skill“-Indikatoren zusammenfassen.

Wenn die Flugbahn eines Schülers vom erwarteten Weg abweicht, sendet das System eine Warnung an die Berater. Da die KI „erklärbar“ ist, umfasst die Warnung die spezifischen Faktoren, die die Besorgnis auslösen. Dadurch können Schulen ihre Reaktion individuell anpassen:

* Geringes Engagement? Verweisen Sie den Studenten auf Workshops zu Lernkompetenzen.

* Hohe Arbeitsbelastung/geringer Fortschritt? Passen Sie die akademischen Erwartungen oder die Arbeitsbelastung an.

* Spezifische Wissenslücken? Bieten Sie gezielte Nachhilfe an.

Umgang mit ethischen Risiken

Obwohl die Vorteile erheblich sind, wirft der Einsatz von KI in Klassenzimmern kritische ethische Fragen in Bezug auf Datenschutz, Voreingenommenheit und Stigmatisierung auf. Kritiker befürchten zu Recht, dass automatisierte Systeme eine „Überwachungskultur“ schaffen oder Studierende unfair benennen könnten.

Um diese Folgen zu verhindern, muss die Implementierung von KI im Bildungsbereich drei strengen Grundsätzen folgen:

- Human-in-the-Loop: KI sollte niemals endgültige Entscheidungen treffen. Es sollte Erkenntnisse liefern, die ein menschlicher Lehrer überprüfen und validieren muss.

- Strenges Fehlermanagement: Systeme müssen ständig überprüft werden, um technische Fehler zu verhindern (z. B. die Verwechslung des Status „zurückgezogen“ mit „bestanden“).

- Gerechtigkeit durch Design: Schulen müssen die Datenerfassung auf das Notwendige beschränken, diese Daten streng schützen und sicherstellen, dass Familien über einen Mechanismus verfügen, um automatisierte Ergebnisse anzufechten.

Das Fazit

Der Preis der Untätigkeit ist hoch. Das späte Erkennen akademischer Probleme führt zu erhöhtem Stress bei den Schülern, einem Vertrauensverlust der Eltern und höheren institutionellen Kosten. Durch die Einführung transparenter, erklärbarer KI können Schulen Routinedaten in ein leistungsstarkes Instrument für Gerechtigkeit umwandeln und so sicherstellen, dass kein Schüler durchs Raster fällt, nur weil sein Kampf unbemerkt geblieben ist.

Schlussfolgerung: Wenn Explainable AI auf einer Grundlage von Transparenz und menschlicher Aufsicht aufbaut, bewegt es die Bildung weg von teuren Reparaturen im Spätstadium und hin zu einem Modell der kontinuierlichen, personalisierten Unterstützung, das sowohl den Schülern als auch der Gesellschaft zugute kommt.