L’intelligence artificielle (IA) est rapidement passée d’un concept futuriste à une réalité quotidienne, remodelant discrètement le travail, l’éducation et même les interactions personnelles. En seulement trois ans depuis la sortie de ChatGPT, les systèmes d’IA ne sont plus de simples outils expérimentaux : ils sont devenus une infrastructure fondamentale, intégrée aux opérations quotidiennes de tous les secteurs et institutions. Ce changement est marqué à la fois par des opportunités et des préoccupations croissantes.

L’omniprésence de l’IA

L’intégration de l’IA se produit à plusieurs niveaux. Dans l’éducation, les enseignants utilisent l’IA pour des tâches telles que la notation, tandis que les étudiants exploitent la technologie pour des activités nuisibles, telles que la création de deepfakes non consensuels. Des entreprises, dont une société de paiement suédoise, ont adopté l’IA pour rationaliser leurs opérations, parfois jusqu’à la surautomatisation, conduisant à une réévaluation des besoins en main-d’œuvre humaine.

L’ampleur des investissements dans l’IA est stupéfiante ; Gartner estime que les dépenses ont atteint 1 800 milliards de dollars l’année dernière. Cependant, cette expansion a un coût environnemental : les centres de données d’IA consomment d’énormes quantités d’énergie, avec des installations individuelles rivalisant avec la consommation électrique de 100 000 foyers – et des centres encore plus grands sont en développement.

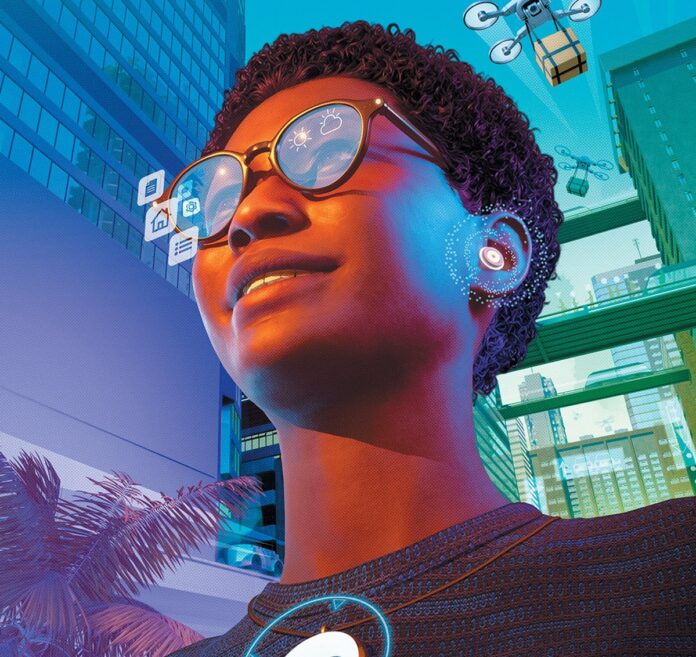

Humain + Machine : la nouvelle réalité

Le discours « humain contre machine » est dépassé. Le paysage actuel est celui de la collaboration sous les contraintes du monde réel, motivées par des données imparfaites et des institutions défectueuses. L’IA ne remplace pas entièrement les humains mais les augmente, parfois pour le meilleur (les cliniciens utilisent l’IA pour réduire les charges administratives), parfois pour le pire (la propagation de fausses informations via les deepfakes).

Ce partenariat déplace les responsabilités, les « copilotes » de l’IA brouillant souvent les frontières entre assistance et contrôle. La rapidité offerte par ces systèmes se fait au prix d’une prise de décision critique, obligeant les utilisateurs à évaluer constamment s’ils doivent faire confiance aux suggestions de la technologie.

Augmenter les préjudices et l’irresponsabilité

Le risque le plus important n’est pas que l’IA dépasse l’intelligence humaine, mais plutôt la vitesse à laquelle les dommages peuvent s’étendre. Les deepfakes peuvent ruiner des réputations avant que la vérification ne soit possible, et même des erreurs bénignes d’IA (telles que des faits hallucinés) peuvent avoir de graves conséquences dans des contextes professionnels comme les soins de santé.

La facilité avec laquelle les avantages de l’IA sont vantés alors que ses inconvénients sont rejetés crée un déséquilibre dangereux. La question demeure : qui porte la responsabilité en cas de défaillance de ces systèmes ? L’efficacité de la technologie rend la responsabilité plus difficile à établir, laissant les individus et les institutions vulnérables à des conséquences imprévues.

L’IA n’est plus une possibilité future ; c’est une réalité actuelle qui exige un examen attentif de ses implications sociétales, éthiques et environnementales. À mesure que la technologie continue d’évoluer, le défi consiste à gérer son énergie de manière responsable, avant que les préjudices ne dépassent les avantages.